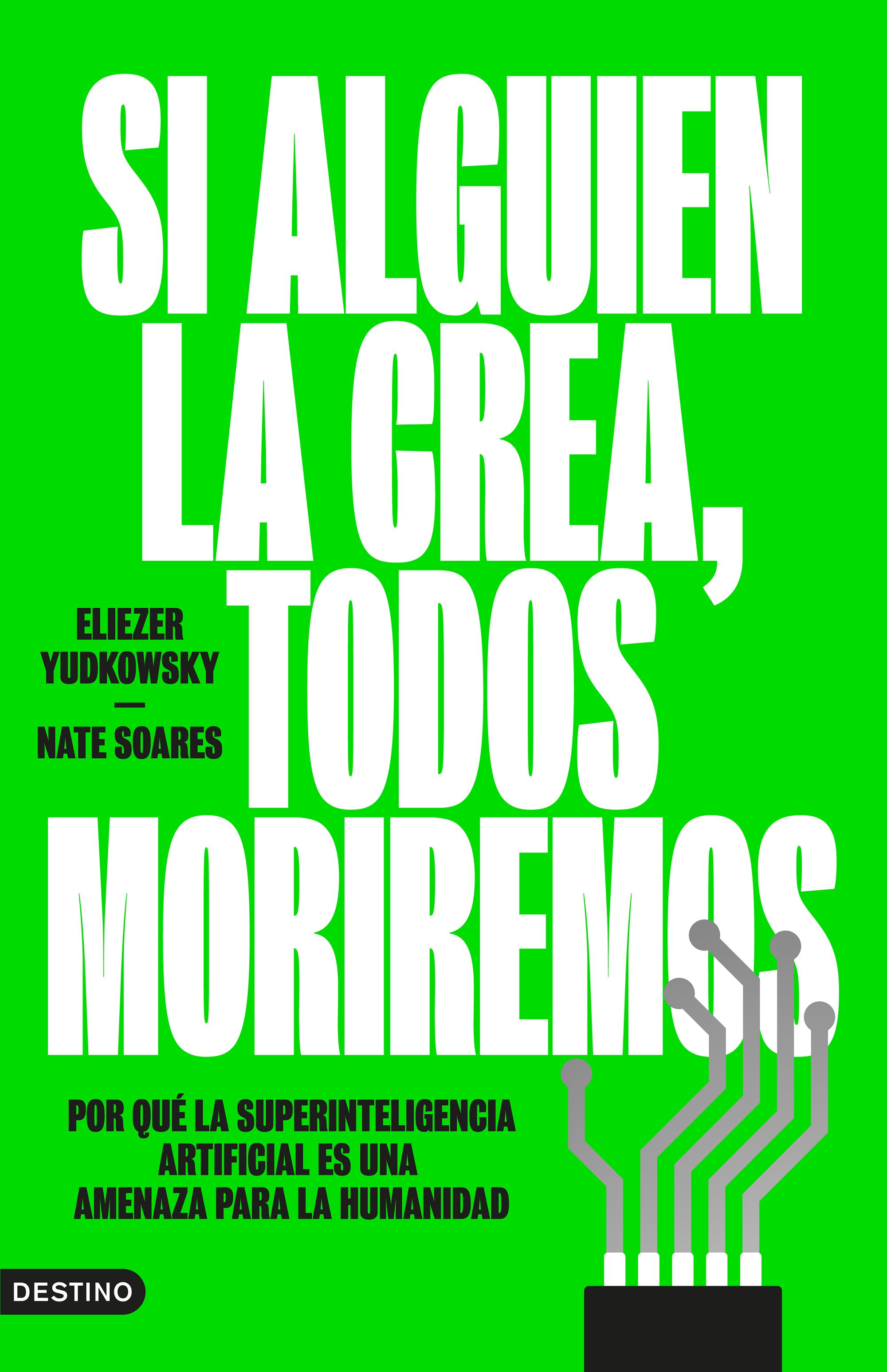

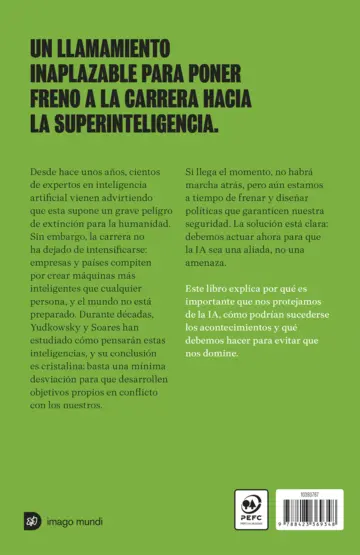

Un llamamiento inaplazable para poner freno a la carrera hacia la superinteligencia.

«Un libro muy interesante, incluso si no estás de acuerdo con su conclusión.» Marta Peirano, periodista y escritora especializada en tecnología y poder.

«Un ensayo provocador que, aunque se equivoca al vaticinar la extinción humana, acierta al identificar el desafío: la llegada de sistemas de IA...